生成扩散模型漫谈(二十三):信噪比与大图生成(下)

上一篇文章《生成扩散模型漫谈(二十二):信噪比与大图生成(上)》中,我们介绍了通过对齐低分辨率的信噪比来改进noise schedule,从而改善直接在像素空间训练的高分辨率图像生成(大图生成)的扩散模型效果。而这篇文章的主角同样是信噪比和大图生成,但做到了更加让人惊叹的事情——直接将训练好低分辨率图像的扩散模型用于高分辨率图像生成,不用额外的训练,并且效果和推理成本都媲美直接训练的大图模型!

这个工作出自最近的论文《Upsample Guidance: Scale Up Diffusion Models without Training》,它巧妙地将低分辨率模型上采样作为引导信号,并结合了CNN对纹理细节的平移不变性,成功实现了免训练高分辨率图像生成。

思想探讨 #

我们知道,扩散模型的训练目标是去噪(Denoise,也是DDPM的第一个D)。按我们的直觉,去噪这个任务应该是分辨率无关的,换句话说,理想情况下低分辨率图像训练的去噪模型应该也能用于高分辨率图像去噪,从而低分辨率的扩散模型应该也能直接用于高分辨率图像生成。

有这么理想吗?笔者用之前自己训练的128*128的人脸图像(CelebA-HQ)扩散模型试了一下,即直接将它当成256*256的模型来推理,生成结果的画风是这样的:

将128分辨率的扩散模型当256分辨率用的生成效果

可以看到,生成结果有两个特点:

1、生成结果已经完全不是人脸图,说明128*128训练的去噪模型无法直接当成256*256的来用;

2、生成结果虽然不理想,但很清晰,没有明显模糊或者棋盘效应,且保留了一些人脸的纹理细节。

我们知道,直接将小图放大(上采样),就是一个最最基本的大图生成模型,但取决于上采样算法的不同,直接放大后的图片通常都会有模糊或者棋盘效应的出现,即缺乏足够的纹理细节。这时候一个“异想天开”的想法是:既然小图放大缺乏细节,而直接将小图模型当大图模型推理会保留一些细节,那么我们可否用后者给前者补充细节?

这就是原论文所提方法的核心思想。

数学描述 #

这一节我们用公式把思路重新整理一下,看下一步该怎么做。

首先统一一下符号。我们目标图像分辨率是w×h,训练图像分辨率是w/s×h/s,所以下面的x,ε都是w×h×3大小(对于图像来说还有个通道维度),而xlow,εlow都是w×h×3大小,D是将w×h分辨率平均Pooling到w/s×h/s的下采样算子,U则是将w/s×h/s分辨率最邻近插值(即直接重复)到w×h的上采样算子。

我们知道,扩散模型需要一个训练好的去噪模型ϵθ(xt,t),以DDPM为例(这里采用的是《生成扩散模型漫谈(三):DDPM = 贝叶斯 + 去噪》一文的形式,跟主流形式基本对齐),它的推理格式为

xt−1=1αt(xt−β2tˉβtϵθ(xt,t))+σtε,ε∼N(0,I)

其中σt的主流取法是ˉβt−1βtˉβt或者βt。但现在我们没有在w×h分辨率下训练好的ϵθ(xt,t),只有一个w/s×h/s分辨率下训练好的ϵθ(xlowt,t)。

根据我们的经验,将大图缩小后再放大,虽然会导致失真,但它还可以算是原图的一个比较好的近似。这启发我们,去噪模型可以类似地构建出一个主项出来,具体来说,为了对w×h大小的图像去噪,我们可以先将它缩小(下采样,平均Pooling)到w/s×h/s,然后送入在w/s×h/s分辨率训练好的去噪模型中进行去噪,最后将去噪结果放大(上采样)到w×h,这样虽然不是理想的去噪结果,但应该已经是理想结果的一个主项。

接着,上一节我们演示了直接将低分辨率训练的去噪模型当成高分辨率模型用,能够保留一些纹理细节,所以我们可以认为完全不加改动的ϵθ(xt,t)则可以构成一个描绘细节的次要项。想办法将这主、次两项整合在一起,也许我们就可以得到精准去噪模型的一个足够好的近似,从而实现免训练的高分辨率扩散生成。

再请SNR #

现在我们来讨论主项。首先我们明确,这篇文章并不是要重新训练一个高分辨率模型,而是要复用原本的低分辨率模型到高分辨率输入上,所以noise schedule还是原来的ˉαt,ˉβt,于是我们可以假定同样有

xt=ˉαtx0+ˉβtε

其中ε是标准正态分布的向量。根据上一节所述,主项需要先下采样后再去噪,设D代表下采样到w/s×h/s的平均Pooling运算,那么我们有

D[xt]=ˉαtD[x0]+ˉβtsε

这里的相等指的是服从同一分布。在上一篇文章中,我们引入了信噪比SNR(t)=ˉα2tˉβ2t,由此可见xt的信噪比是ˉα2tˉβ2t,但D[xt]的信噪比是s2ˉα2tˉβ2t。根据本文的设置,去噪模型ϵθ(xt,t)只在noise schedule为ˉαt,ˉβt的低分辨率图像上训练过,这意味着t时刻的ϵθ(xt,t)适用的输入信噪比是ˉα2tˉβ2t,但D[xt]的信噪比是s2ˉα2tˉβ2t,所以直接用t时刻的模型效果不是最佳的。

那怎么办呢?很简单,信噪比随着时间t的变化而变化,我们可以找另一个时刻τ,使得它的信噪比就是s2ˉα2tˉβ2t,也就是解方程

ˉα2τˉβ2τ=s2ˉα2tˉβ2t

解出τ后,我们就得到τ时刻的模型更适合于信噪比为s2ˉα2tˉβ2t的输入,于是D[xt]的去噪应该适用τ时刻而不是t时刻的模型。此外,D[xt]本身还可以改进一下,从式(3)可以发现当s>1时两个系数平方和ρ2t=ˉα2t+ˉβ2ts2不再是1,而训练阶段的系数平方和都是1,所以我们可以将它除以ρt,使其更接近训练结果的形式。最终由D[xt]构建的去噪模型主项应该是

ϵθ(D[xt]ρt,τ)

分解近似 #

现在有两个去噪模型可以用,一项是直接将低分辨率模型ϵθ(xlowt,t)当高分辨率用的ϵθ(xt,t),另一项是上一节推出来的先下采样再去噪的模型(5),接下来我们就可以尝试将它们组装起来了。

假设我们有一个经过高分辨率图像训练过的完美去噪模型ϵhigh(xt,t),那么我们可以将它分解为

ϵhigh(xt,t)=U[D[ϵhigh(xt,t)]]⏟低分辨率主项+{ϵhigh(xt,t)−U[D[ϵhigh(xt,t)]]}⏟高分辨率细节项

咋看上去,这个分解只是简单的恒等变换,但实际上它有非常直观的意义:第一项是将精确的重构结果先下采样然后上采样,说白了先缩小后放大,这是一个有损变换,但得到的结果还是足以描绘主体轮廓,所以它是主项;第二项则是将精确结果减去主体轮廓,得到的很明显就代表着局部细节。

结合我们之前讨论的思路,我们认为上一节所给出的式(5)是低分辨率主项的一个良好近似,所以我们写出

D[ϵhigh(xt,t)]≈1sϵθ(D[xt]ρt,τ)

注意不能漏了前面的因子1/s,这是因为去噪模型通常预测的是标准正态噪声(即ε),因此它的输出本身近似满足零均值和单位方差,经过下采样D之后方差变为1/s2,而ϵθ的输出同样是单位方差的,所以要除以s使得方差变为1/s2,以提高近似程度。

对于高分辨率细节项,我们则写出:

ϵhigh(xt,t)−U[D[ϵhigh(xt,t)]]≈ϵθ(xt,t)−U[D[ϵθ(xt,t)]]

这同样是基于前面讨论的思路——直接将低分辨率去噪模型当高分辨率模型用,其中纹理细节的地方保留得比较好,所以我们认为对于高分辨率细节,ϵθ就是ϵhigh的一个良好近似。

综合这两项近似,我们就可以完整地写出:

ϵhigh(xt,t)≈1sU[ϵθ(D[xt]ρt,τ)]+{ϵθ(xt,t)−U[D[ϵθ(xt,t)]]}≜ϵapproxθ(xt,t)

这就是我们要寻找的高分辨率去噪模型的关键近似!

事实上,直接用式(9)来生成高分辨率图已经有不错的效果了,但我们还可以引入一个可调的超参数,使其可以做得更好一些。具体思路是模仿《生成扩散模型漫谈(九):条件控制生成结果》通过无条件模型来加强条件生成的做法,我们将ϵapproxθ(xt,t)看成是条件去噪模型,其中引导信号就是低分辨率上采样的主项(即论文标题的“Upsample Guidance”,简称UG),而ϵθ(xt,t)则看成是无条件去噪模型,我们要加强条件,所以引入可调参数w>0,将最终所用的去噪模型表示为

˜ϵθ(xt,t)=(1+w)ϵapproxθ(xt,t)−wϵθ(xt,t)=ϵθ(xt,t)+(1+w)U[1sϵθ(D[xt]ρt,τ)−D[ϵθ(xt,t)]]

根据原论文的实验结果,w=0.2附近的效果比较好。

LDM扩展 #

虽然在形式上前述结果似乎不区分是Pixel空间的扩散模型还是隐空间的扩散模型(LDM),但事实上从理论的角度看前述结果只适用于Pixel空间的扩散模型,LDM多了一个非线性的Encoder,大图经过Encoder之后的特征,Pooling之后未必等于小图经过Encoder之后的特征,因此我们通过先下采样后上采样来近似构建高分辨率去噪模型的主项这一假设未必还成立。

为了观察LDM场景下有什么不同之处,我们可以看原论文的两个实验结果。第一个是将Encoder的特征上/下采样后送入Decoder后的重建结果,如下图所示。结果显示不管是上采样还是下采样,直接在特征空间进行此类操作,都会导致图像的劣化,这意味着先通过下采样去噪然后上采样构建的主项权重或许要适当降低。

对Encoder的特征进行上:下采样,都会导致Decoder的结果劣化

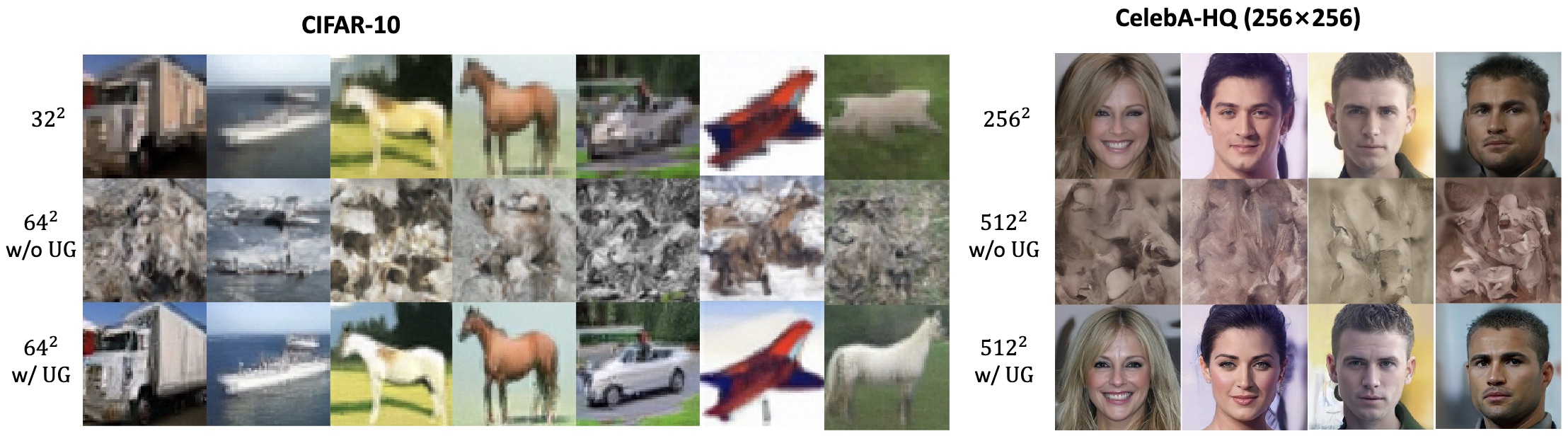

第二个实验是直接将低分辨率的LDM不加改动地当高分辨率模型用,其结果送入Decoder后的生成结果可以参考下图的“w/o UG”部分。可以看到,跟Pixel空间的扩散模型不同,大体是得益于Decoder对特征的鲁棒性,LDM场景下ϵθ(xt,t)直接当高分辨率模型用的效果理想很多,语义和清晰度都有明显保证,只是个别地方出现了一些“畸形”。

是否加Upsample Guidance(UG)的小图LDM用于生成大图的效果区别

基于这两个实验结论,原论文将LDM场景下的w改为跟时间t相关的函数:

wt={w,t≥(1−η)T−1,t<(1−η)T

当w=−1时,Upsample Guidance就等价于不存在,这就相当于说Upsample Guidance只加在扩散前期,这既能够在前期通过Upsample Guidance更好地防止畸形,又能够在后期充分利用ϵθ(xt,t)生成更清晰锐利的结果,同时还节省计算量,可谓“一箭三雕”了。

效果演示 #

终于来到实验环节了。其实上一节的图片中的“w/ UG”部分,已经演示了Upsample Guidance在LDM场景的效果,可以看到Upsample Guidance确实能纠正ϵθ(xt,t)直接用于高分辨率生成带来的畸形,同时保证语义的正确性和图像的清晰度。

至于Pixel空间的生成效果,则可以参考下图:

原论文演示的Upsample Guidance在Pixel扩散模型上的效果

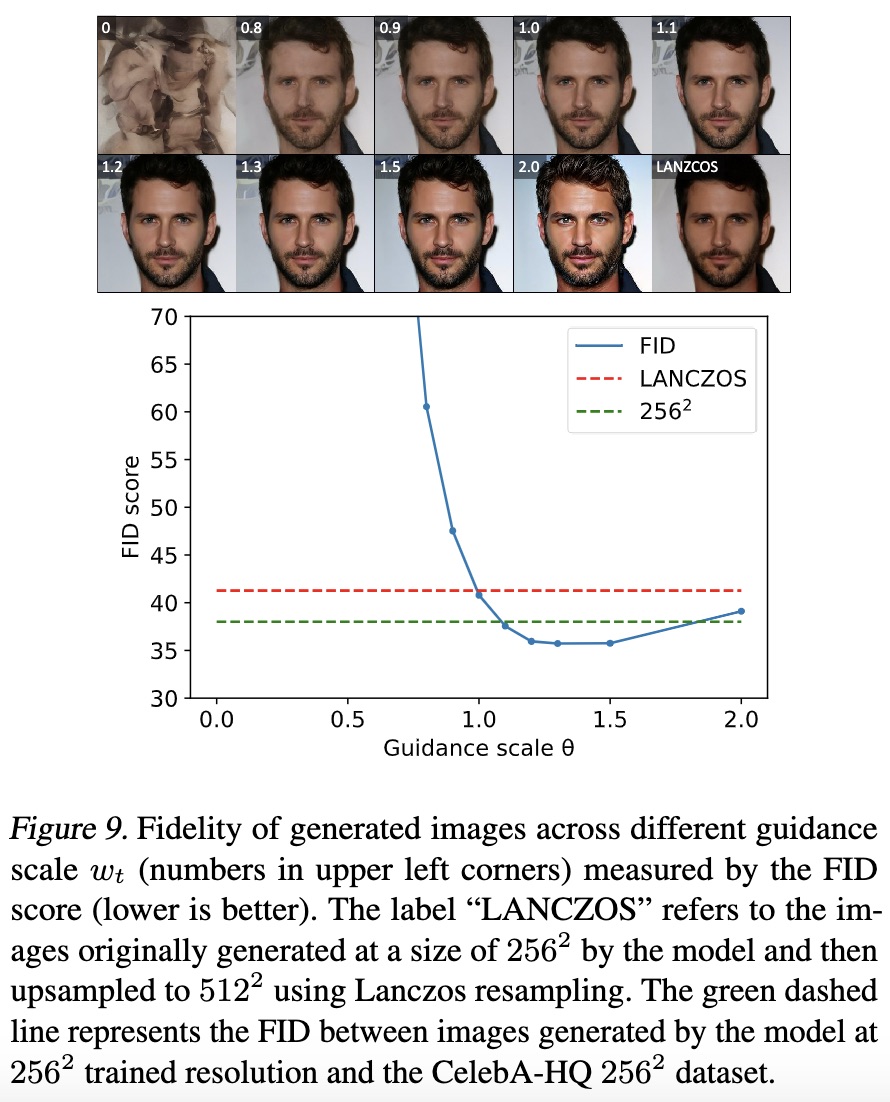

由于Upsample Guidance的存在,整个方法有点像是先生成低分辨率图像然后通过超分辨率方法生成高清图,只不过它是以无监督的方法进行,所以基本上可以保证FID等不差于低分辨率的生成结果:

FID指标与超参数关系(它这里的wt和θ等于本文的w加上1)

最后,笔者也用自己之前训练的128*128的CelebA人脸扩散模型进行了尝试,进一步肯定了Upsample Guidance的有效性:

个人实验效果。左边是训练分辨率(128)生成效果,中、右分别是Upsample Guidance生成的256、512分辨率生成效果

效果上,肯定不如直接训练的高分辨率模型,但比低分辨率图直接放大效果要好;推理成本上,相比于将ϵθ(xt,t)用高分辨率图像训练后直接用于生成,Upsample Guidance多了一项低分辨率的计算,计算成本的增加比例大致上是1/s2,如果是LDM则由于生成后期不加入Upsample Guidance,因此这个比例还更少。总的来说,Upsample Guidance称得上是成本合理的大图生成免费午餐了。

思考分析 #

看完Upsample Guidance整个框架,不知道大家的感受是什么?笔者的感觉是非常像物理学家的风格,天马行空、大胆假设但又在无形之中把握住了本质。这类工作让笔者写个解读或许没啥问题,但自己独立想出来的话是万万不可能的,因为笔者充其量也只有一点很死板的数学思维。

关于Upsample Guidance的一个很自然的疑问是:它有效的原因究竟是什么?以笔者在Pixel空间训练的CelelbA人脸生成模型为例,它只在128*128的小图上训练过,完全没见过256*256的大图,那它为什么能恰如其分地生成符合我们认知的256*256大图?注意这还跟ImageNet不同,ImageNet数据集是一个多尺度的数据集,比如一张128*128的图,它可能是一条鱼,也可以是一个人手里拿着一条鱼,也就是说虽然都是128*128的输入,但它见过不同比例的鱼,从而能更好地适应不同的分辨率,但CelelbA不一样,它是单尺度的数据集,所有人脸的大小、位置、朝向都是对齐的,但即便如此,Upsample Guidance依然可以成功地将它泛化到了

笔者认为,这多少跟DIP(Deep Image Prior)有点联系。DIP的大致意思是说,CV常用的CNN模型,其架构本身就已经经过高度筛选,非常契合视觉本身,所以哪怕不经过真实数据训练的模型,也能够完成一些视觉任务,如去噪、补全甚至简单的超分等。Upsample Guidance可以让完全没见过大图的扩散模型生成基本合乎认知的大图,看上去也是得益于CNN本身的架构先验。简单来讲,正如本文第一节所实验的,Upsample Guidance依赖于直接将低分辨率模型当高分辨率模型用,生成结果至少保留了一些有效的纹理细节,这一点并不是平凡的性质。

为了验证这一点,笔者特意去拿之前训练的纯Transformer扩散模型(有点类似DiT + RoPE-2D)去尝试了一下,发现完全不能重现Upsample Guidance的效果,这表明它至少是对CNN-based的U-Net模型架构有所依赖的。不过用Transformer的读者也不用灰心,它虽然不能走Upsample Guidance的路线,但可以走NLP的长度外推的路线。《FiT: Flexible Vision Transformer for Diffusion Model》一文表明,通过Transformer + RoPE-2D的组合训练扩散模型,可以复用NTK、YaRN等长度外推技术,达到免训练或者极少量的微调就可以生成高分辨率图的效果。

文章小结 #

这篇文章介绍了一个名为Upsample Guidance的技巧,它可以让训练好的低分辨率扩散模型直接生成高分辨率图片,而不需要额外的微调成本,实验显示它基本上能稳定提高至少1倍的分辨率,虽然效果离直接训练的高分辨率扩散模型还有点差距,但这近乎免费的午餐依然值得学习一番。本文从笔者的角度重新整理了该方法的思路和推导,并给出了关于其有效性原因的思考。

(后记:事实上,按照最初的计划,这篇文章是在两天前发布的,之所以推迟了两天,是因为在写作过程中笔者发现很多开始自以为理解的细节,实际上还含糊不清,所以多花了两天时间进行推导和实验,以获得更精准的理解。由此可见,将要学习的东西系统清晰地重述出来,本身也是一个不断自我完善和改进的过程,这大概就是坚持写作的意义所在吧。)

转载到请包括本文地址:https://spaces.ac.cn/archives/10055

更详细的转载事宜请参考:《科学空间FAQ》

如果您还有什么疑惑或建议,欢迎在下方评论区继续讨论。

如果您觉得本文还不错,欢迎分享/打赏本文。打赏并非要从中获得收益,而是希望知道科学空间获得了多少读者的真心关注。当然,如果你无视它,也不会影响你的阅读。再次表示欢迎和感谢!

如果您需要引用本文,请参考:

苏剑林. (Apr. 17, 2024). 《生成扩散模型漫谈(二十三):信噪比与大图生成(下) 》[Blog post]. Retrieved from https://spaces.ac.cn/archives/10055

@online{kexuefm-10055,

title={生成扩散模型漫谈(二十三):信噪比与大图生成(下)},

author={苏剑林},

year={2024},

month={Apr},

url={url{https://spaces.ac.cn/archives/10055}},

}

相关知识

基于生成对抗网络的植物景观生成设计——以花境平面图生成为例

18款AI绘画生成软件推荐,必备工具,一键生成绘画!

大模型生成RPG游戏,情节角色DIY!谷歌出品,一作上海交大校友

探索植物模型AI生成:主流软件盘点与功能比较指南

中国科大在基于深度生成模型的功能蛋白质设计方面取得新进展

【科学网】中国科大在基于深度生成模型的功能蛋白质设计方面取得新进展

“PKPM生成图+CAD修改=施工图”工法下字体的掌控

全方位推荐:虚拟植物AI生成工具大盘点,满足您的个性化创造需求

设计师解放双手之作!3秒生成风景园林效果图,AIGC赋能景观设计

给力!南开团队刷新图像生成模型质量和速度!浪潮信息AIStation支撑

原文链接: 生成扩散模型漫谈(二十三):信噪比与大图生成(下) https://www.huajiangbk.com/newsview1352909.html

| 上一篇: 扩散解释 | 下一篇: 科学网—基于Delft3D模型水... |

推荐分享

- 1君子兰什么品种最名贵 十大名... 4245

- 2世界上最名贵的10种兰花图片... 3564

- 3花圈挽联怎么写? 3499

- 4鲜花养护:帝王花的养殖方法以... 3436

- 5明日花キララ:明日花绮罗年度... 2413

- 6迷信说家里不能放假花 家里摆... 2059

- 7香山红叶什么时候红 1677

- 8花的意思,花的解释,花的拼音... 1380

- 9教师节送什么花最合适 1347

- 10勿忘我花图片 1283